清华大学林星助理教授:训练大规模光子神经网络

该成果发表在Nature Machine Intelligence,题为“Dual Adaptive Training of Photonic Neural Networks”,博士研究生郑紫阳、段正阳为论文的共同第一作者,林星助理教授与熊红凯教授担任论文的共同通讯作者。参加研究的作者还包括清华大学电子系陈航博士后、博士研究生高升、张海欧工程师,上海交通大学电子系博士研究生杨睿。

视频:光子神经网络对偶自适应训练方法概览

优化网络建模能够提升对系统的建模精度,实现更精确的梯度计算。优化任务推理使得PNN物理模型能够适应动态系统误差,实现更高的任务执行性能。两者彼此依赖、相互促进。上述步骤在训练数据集中迭代运行直到收敛。

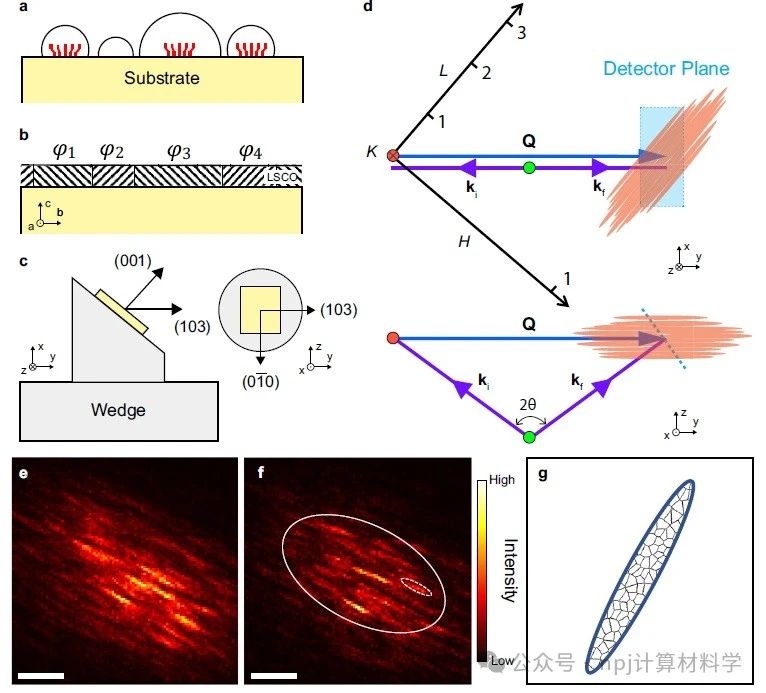

图1 光子神经网络的对偶自适应训练方法

空间光计算系统通过构建大规模的光学相控阵列,可以实现高复杂度的光学互联网络架构。研究人员首先在基于衍射的空间光计算系统上验证了对偶自适应训练方法的有效性,其系统架构如图 2a 所示。相干激光经过反射后照射到数字微透镜阵列,将输入信息编码到传播光场的振幅中;经过4f 光学系统后照射到空间光调制器上,进行相位调制;最后,传播光场衍射到传感器,读取强度值。对应的实验平台如图 2b 所示。在该系统中,空间光调制器的相位调制对应神经网络的可学习参数,而传感器读取强度值对应于非线性激活函数。上述系统可视为衍射光子神经网络的一层,通过将上一层读取的强度值当做下一层的输入信息,可实现复杂架构的多层衍射光子神经网络。

图2 训练衍射光子神经网络

研究人员在实验平台上构建了含12万神经元的三层衍射光子神经网络,用于执行 MNIST 数据集的数字分类任务和 Fashion-MNIST数据集的商品分类任务。当在计算机上建模理想的网络模型并完成训练之后,数字和商品分类的准确率为 93.7% 和 85.6%。然而,将该模型参数直接部署到实验平台后,准确率骤降至28.3% 和 11.1%,说明实验平台存在大量的系统误差累积,严重影响了任务推理过程。除了常见的几何误差、制造误差外,研究人员还在实验平台的传感器上观测到动态读出误差和时变偏移误差。而将对偶自适应训练得到的模型参数部署到实验平台后,准确率大幅提升至92.4% 和 77.3%,相比于直接部署提升了 64.1% 和 66.2%。

研究人员也对比了领域前沿的其他训练方法,包含2022 年发表在 Nature 的物理感知训练(Physics-Aware Training)和 2021 年发表在 Nature Photonics 的自适应训练(Adaptive Training)等方法。实验结果表明,物理感知训练和自适应训练仅能将数字分类的准确率分别提升至39.6%和53.1%,而对商品分类任务中几乎无效,准确率徘徊在 10%。相比之下,对偶自适应训练在数字分类任务上准确率分别提升了52.8% 和 39.3%,在商品分类任务上准确率均提升近 67%。图 2c 展示了“数字 7”在不同训练方法得到的模型中的输出分类情况,仅对偶自适应训练方法分类正确。图 2d 展示了对偶自适应训练得到的模型在数字分类任务上的混淆矩阵,取得了92.4% 的分类准确率。

研究人员同样在仿真平台上搭建了不同架构的衍射光子神经网络,探究不同训练方法在多种复杂系统误差环境下的有效性。图 3a 和图 3b 分别展示了单层(DPNN-S)和多层互联(DPNN-M)的光子衍射神经网络架构。其中,单层网络中的模块包含三段衍射过程和两个相位调制层,而多层网络由七个该模块经过复杂互联得到,含 28万神经元。针对每种架构,研究人员分别设置了三种复杂误差环境,包括水平偏移、垂直偏移、平面旋转和相位偏移等多种误差来源,并假设误差发生在任一可能位置。图 3c 展示了多种训练方法得到的模型在数字和商品分类任务的准确率。无论对偶自适应训练方法不测量(w/o IS)或测量(w/ IS)系统中间状态,其性能总领先于其他方法,且在大规模网络下更具优势。这些结果进一步验证了对偶自适应训练方法对物理系统的精确建模和更新梯度的准确计算。值得注意的是,系统误差预测网络模块采用微型的复数 U-Net 架构,参数量仅为 26,909,约为标准 U-Net 参数量(7,765,442)的 0.347%。

图3 训练不同架构的衍射光子神经网络

有效的训练方法属于实现高性能人工智能系统的关键技术。本项研究提出了用于训练大规模光子神经网络的对偶自适应训练方法,在动态系统误差环境下,成功训练了基于空间衍射和片上干涉的光子神经网络。研究解决了网络梯度精确计算的难题,实现了端到端的网络参数更新,无需增加额外反向传播硬件,可适用于更大规模的光子神经网络训练,且能拓展到训练任意架构的光子神经网络以及模拟神经网络,有望促进光子神经网络的产业落地和广泛应用。

Ziyang Zheng, Zhengyang Duan, Hang Chen, Rui Yang, Sheng Gao, Haiou Zhang, Hongkai Xiong & Xing Lin. Dual adaptive training of photonic neural networks. Nat Mach Intell (2023).

免责声明:本文旨在传递更多科研资讯及分享,所有其他媒、网来源均注明出处,如涉及版权问题,请作者第一时间联系我们,我们将协调进行处理,最终解释权归旭为光电所有。

![[文献速递Vol.215]-SNR-Net OCT:通过深度学习对低光光学相干断层扫描图像进行增亮和去噪](http://www.surisetech.com/wp-content/uploads/2024/01/wen-xian-su-di-vol215snrnetoct-tong-guo-shen-du.png)