AI时代,光子技术降耗又增效

想象一下,当你从俄勒冈州波特兰驱车向东前往达拉斯方向,沿途的风景从郁郁葱葱的沿海林地逐渐转变为广袤的内陆沙漠。在这里,沿河矗立着一座历史悠久的大坝,长期以来一直是人类能源需求的重要支柱——自2006年起为谷歌最庞大数据中心供电。然而,即便是像达尔斯市这样拥有丰富水电资源的地区,也正面临着前所未有的挑战——人工智能的快速发展对服务器、存储设备和数据网络提出了极高的要求,这些基础设施的能源消耗正在以空前的速度增长。

ChatGPT等生成类AI的兴起,将这一技术带入了千家万户的日常生活。它们能够编写电子邮件、回答问题、创作软件内容,甚至以聊天机器人的形式改善客户体验,或协助处理数据输入等重复性任务。然而,这些看似智能的程序背后,隐藏着巨大的能源消耗,运行这些服务器需要大量的能源、碳和水资源。与传统的搜索工具相比,ChatGPT等生成类AI在每次查询时消耗的电力更为惊人。

根据国际能源机构(IEA)的最新报告,一次谷歌搜索仅耗电0.3瓦时,而使用ChatGPT进行一次查询却需要消耗2.9瓦时的电力,这相当于让一个60瓦的灯泡持续亮起几分钟才能生成一页文本。

《华尔街日报》预测,到2030末,人工智能数据中心可能会消耗美国20%至25%的电力需求,远高于当前的4%。除了能源需求外,AI还带来了巨大的水资源消耗。冷却过程中需要大量的水,其中大部分最终会蒸发而消失。根据IEA的预测,2026年全球AI所需的数据中心用水量将达到惊人的150亿至750亿升,这相当于欧洲200万至1000万人的住宅用水量。

光子处理器

以色列Bar-Ilan大学的光电子学教授Zeev Zalevsky表示:“我们现在追求的不仅是更快的计算速度或更大的存储容量,还有如何优化计算过程中的电力消耗。”他认为,光计算的未来趋势是构建独立的光子处理器,不依赖于今天的硅芯片基础架构,而是能够与光通信系统集成,将电子世界的信息注入光子载体并通过光纤传输。他的团队以及全球其他研究小组正致力于开发前沿技术,利用光子替代电子,以应对日益增长的计算能力需求。

光子处理器,其核心在于用光而不是电流进行数字计算,光子通过波导和其他元件来处理信息。光子在信息传输方面具有优势,携带信息的带宽远超电子,且在传输高频信息时抗噪能力更为出色。光子处理器非常适合线性空间转换(如反射或旋转平面),早期通过干涉仪传递光信号的光学计算系统就可以实现。然而,当面临需要多个信号相互作用的复杂计算问题时,光子处理器的整合应用仍面临挑战。

神经网络的发展为这一难题带来了转机。传统电子处理器中基于布尔逻辑门构建的模块,其非线性运算无法用光来复制实现,但是对于神经网络模型处理器,这种复杂性仅仅是结构上的叠加。基本的计算单元——神经元,能够利用光子实现其功能,例如光子在二氧化硅中的传输。神经网络由多个神经元组成,神经元之间通过权重相互连接。通过调整每对光信号的权重,神经网络能够被训练解决不同类型的问题。

Zalevsky教授从多芯光纤入手。不同于传统通信光纤中信息通道的独立隔离设计,他的技术核心在于光在光纤纤芯之间的动态交换。这一过程正是神经网络功能实现的关键所在,各层级接收输入信号,执行加权求和运算,并据此作出推理判断。而且,光纤中的非线性效应为神经网络处理单元的激活功能提供了基础——光学输入强度的加倍并不会简单地使输出强度翻倍。

Zalevsky与同事Eyal Cohen携手创立CogniFiber公司,利用多芯光纤这项新技术构建神经网络,展现了基本计算功能。在他们的原型中,90个硅芯和13个激光信息通道组成了一个神经网络,成功实现了对特定输入模式的“学习”与识别,并据此解析出多激光输入信号。

在这个信息爆炸的时代,光子处理器将成为我们筛选有价值信息、洞察潜在威胁的重要工具。例如,在智能家居领域,光子处理器能够实时分析传感器数据,剔除冗余信息,及时预警潜在的安全风险或设备故障。与同等复杂度的电子处理器相比,Zalevsky和Cohen的光子处理器展现出了惊人的计算效率与能耗优势。通过简单地增加光纤纤芯数量,即可轻松实现处理器性能与复杂度的双重提升。

对于电子芯片而言,这几乎是不可能完成的任务。然而,他们面临的挑战同样不容忽视,例如如何构建高效、稳定的接口,将基于光纤的光子处理器与现实系统相结合,这是Zalevsky团队未来几年希望解决的软件问题。

基于MEMS的光交换机

自20世纪90年代末起,工程师们已经开始探索光网络,这种光网络是基于电信行业开发的光开关来连接用户。在这一过程中,通过倾斜光学MEMS(微机电系统)开关的微镜阵列的角度,改变光束方向,实现光信号的路径切换。

回望20世纪,机械开关主宰了电信世界。然而,随着现代数据处理网络的迅猛发展,对信息传输速度的要求日益提升,机械开关已难以满足这一需求。相比之下,光网络以其高速、高效的特点,正逐步成为连接芯片、服务器乃至数据中心之间信息传输的重要桥梁。

2023年,谷歌报告称,光交换机正取代电子交换机用于数据中心联网。服务器之间的连接将使用一个名为Palomar的光学交换系统单元,该单元内置136个独立可控的微镜阵列,当光通过光纤进入Palomar时,反射镜可以快速重新排列,以便每个光信号都被重定向到正确的输出光纤。固定镜子仅需耗电108瓦。相比之下,数据中心的每个标准136端口电子交换机消耗大约3000瓦的电量。

悉尼大学航空航天与机械工程学院副教授Niels Quack对谷歌的这一项光学交换技术赞不绝口。他正在探索,如何让光交换机的性能更上一层楼。这意味着将光学和MEMS技术结合到光子集成电路(PIC)中。与传统的电子微芯片上用于路由电子信息的铜互连不同,带有集成MEMS的光子电路通过移动纳米级机械波导来引导光,为数据中心服务器的集成光路交换机的有效扩展奠定了基础。

然而,当前的硅PIC技术仍面临挑战。大部分设计均需消耗能源维持光连接,通过电流加热硅基波导,改变材料光学性质,从而改变光的路径。但这个过程不仅消耗能量,而且变化是暂时的,一旦热源撤离,连接和信息流就会丢失。

为解决这一难题,华盛顿大学的电气与计算机工程及物理学教授Arka Majumdar和LightIC Technologies的光子学工程师Roger Fang开发了一种通过触发波导中的变化来维持信息流的光子开关,即使关掉热源,光开关扔可工作。他们引入石墨烯层作为超薄加热器,仅对局部进行精准加热,而不是加热整个波导。与最先进的电动相变开关相比,这种方法的开关能耗降低了70倍。

尽管Fang的这种相变开关不需要消耗任何电力来维持设置,但在可靠性方面尚存短板。石墨烯加热器虽能在千次切换内保持稳定,但面对现代计算的海量需求——数十亿次循环——其可靠性无法保证。相比之下,MEMS技术在消费电子产品的数十亿次循环中已被证明是可靠的。

对于光交换机而言,在扩展至大型系统时,其最佳功耗是在光损耗与物理尺寸之间的一种权衡。Quack认为MEMS能够优化这个问题。单个芯片可以容纳数百万个MEMS组件,同时保持极低的片上光损耗和极低的功耗。他的团队开发了硅光子MEMS,利用静电驱动器控制一个独立的、半微米宽波导的运动。目前,他的团队正在研究机械和材料方面,例如可能会带来更高的效率的压电驱动机制。

Quack表示,硅光子MEMS有望在未来五年内以每端口1至10美元的价格达到行业标准的光损耗目标——小于3 dB,即输出功率保留了一半的输入功率。这些芯片可能促使人工智能所需的新型更高效的光子集成电路,在未来十年内取代20世纪90年代末MEMS镜面技术。

光数据存储技术

光学技术为人工智能的能耗优化提供了另一个重要优势——数据备份与长期数据存储。

起初,全球需要存档和处理的数据量以几个太字节(Tb)计,但现在这一数字正在激增,达到拍字节(Pb)和艾字节(Eb)级别。然而,当前依赖的硬盘和磁带存储方式均存在随时间推移而老化的问题,定期迁移数据到新驱动器上既耗能又耗时。于是,光数据存储被成为了低成本、长期数据管理的理想选择。

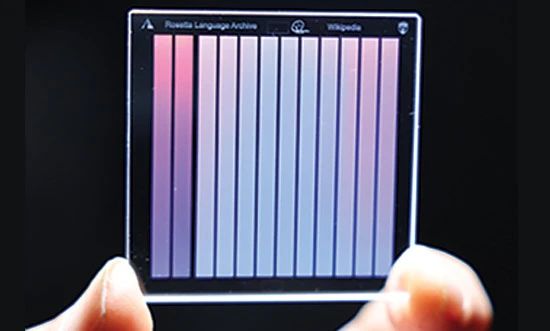

2014年,南汉普顿大学光电学教授Peter Kazansky及其研究团队开发了一种新型光学存储技术,利用激光对石英玻璃进行物理改性,创造出了极其微小的纳米结构。这些结构如同CD和DVD一样无限期存在。但不同之处在于这些纳米结构拥有更高的维度,在一个CD大小的尺寸甚至可以上堆叠数千层的纳米结构。

5D光盘由纳米结构玻璃制成,数据存储和检索使用飞秒激光书写,可以在纳米玻璃中进行微观蚀刻。产生的体素(volumetric pixel,简称voxel)具有半微米厚、数微米深的特征。

然而,这些体素并非简单的空洞。它们可以是纳米光栅或拉长的纳米空隙,其方向、形状和大小可以通过光的偏振和强度来控制,甚至可以根据光通过材料的特性为数据存储增加至五维。这五个维度的结构包括纳米玻璃蚀刻结构的尺寸、方向和三维位置。通过在记录过程中改变光的偏振和强度,可以在第四维 (慢轴方向)和第五维(延迟强度)上添加数据。将这两个光学维度与三个传统的空间坐标相结合,可以使这些玻璃圆盘保存更多的数据。

2024年,上海理工大学光子芯片研究院院长顾敏院士团队利用光存储技术提出了新的大数据存储解决方案,成果以“Pb容量三维纳米光子存储”为题发表在《自然》杂志。该团队的技术结合了双光束技术和一种新型光敏材料,突破了光学衍射极限的限制,在三维空间中实现百层堆叠、超高分辨尺寸下的信息写入和读出,单张光盘容量高达1.6 Pb。

据估计,整个互联网的文本大小约56 Pb,如果用1TB容量的移动硬盘去存储这些数据,平铺开来相当于一个标准田径场的面积。而三维纳米光子存储可以将存储空间节省至一台电脑大小,大大降低了使用成本,同时也降低了维持数据库严苛的运行环境(恒温恒湿、防磁防尘等)需要产生巨大的能耗。

在AI飞速发展、渗透日常生活每一个角落的时代,随着算法的演进和数据规模的膨胀,传统的存储和处理方案已不堪重负。“耗电狂魔”AI发展到现在已不仅是数据和算法的竞争,更是能源的比拼。AI数据中心对能源需求的激增,为可持续数字基础设施提出了紧迫的挑战。光学和光子学领域相关技术正在引领这一变革,提供解决方案。

本文编译自spie.org,转载请注明出处。

免责声明:本文旨在传递更多科研资讯及分享,所有其他媒、网来源均注明出处,如涉及版权问题,请作者第一时间联系我们,我们将协调进行处理,最终解释权归旭为光电所有。